De vierde versie van GPT komt er aan. GPT4 wordt volgens velen de meest geavanceerde en veelbelovende AI. GPT-3 had een significante verbetering in prestaties in vergelijking met GPT-2 en OpenAI lijkt met GPT-4 weer een sprong te willen maken. We zullen het waarschijnlijk in de komende maanden kunnen ervaren. Het nieuwe AI-model zou in het begin van 2023 klaar kunnen zijn.

De concrete specificaties van GPT-4 zijn nog onbekend omdat OpenAI, het bedrijf achter GPT-4, weinig informatie over het model vrijgeeft.

In dit artikel wil ik samenvatten wat we tot nu toe weten over GPT-4 – de feiten, geruchten en algemene verwachtingen over het volgende generatie AI-model.

Wat is GPT?

Voordat we in de details duiken is het belangrijk om te weten wat GPT is. GPT (Generative Pre-trained Transformer) is een AI-model dat tekst kan genereren en dat is getraind met gegevens die beschikbaar zijn op het internet. GPT is ontworpen om menselijke ogende tekst te creëren na input van een gebruiker.

De toepassingen van GPT-modellen zijn eindeloos. Het kan worden gebruikt voor vragen en antwoorden, samenvatting van tekst, vertaling, codegeneratie en nog veel meer. Sommige mensen geloven dat GPT of een vergelijkbaar AI-model in de toekomst Google kan vervangen. De bekendste toepassing van GPT is ChatGPT, een chatbot die vragen kan beantwoorden, artikelen kan schrijven en zelfs softwarecode kan maken voor gebruikers.

GPT biedt ook veel kansen voor ondernemers. Het is mogelijk om het model te fine-tunen met specifieke gegevens om uitstekende resultaten te behalen in een specifiek domein. Startups en bedrijven zullen GPT gebruiken als basis voor de producten die ze creëren. Dat betekent dat ze de kracht van AI kunnen gebruiken, zonder zelf een AI-model te hoeven ontwikkelen.

GPT Release Datum

Een exacte datum voor de release van GPT 4 is nog niet bekend. Wat wel bekend is dat het in 2023 gelanceerd zal worden door OpenAI, het bedrijf achter de GPT-modellen. Veel experts verwachten dat het ergens begin 2023 gereleaset zal worden, maar wanneer precies is niet duidelijk.

Lees meer: OpenAI zet eerste stap naar betaalde versie ChatGPT Professional

Hoe gaat GPT 4 eruit zien? Heeft het echt 100 biljoen parameters?

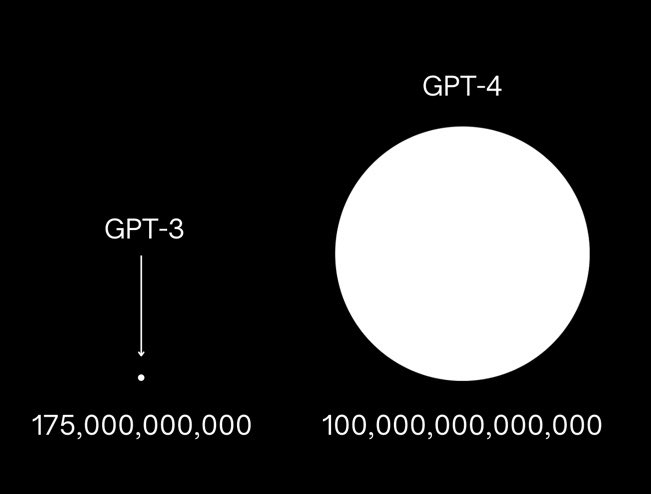

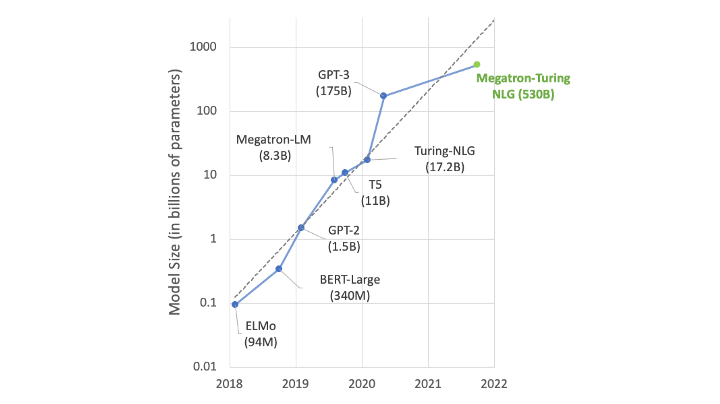

Het aantal parameters dat een AI-model heeft, is een veelgebruikte prestatie-indicator voor hoe geavanceerd een AI-model is. Sinds 2018, toen GPT-1 werd uitgebracht, volgt OpenAI de strategie “hoe groter hoe beter”. GPT-1 had 117 miljoen parameters, GPT-2 had 1,2 miljard parameters en GPT-3 verhoogde het aantal nog verder naar 175 miljard parameters. Dit betekent dat het populaire GPT-3-model 100 keer meer parameters heeft dan GPT-2.

In een interview met Wired in augustus 2021 hintte Andrew Feldman, oprichter en CEO van Cerebras (een bedrijf dat samenwerkt met OpenAI om het GPT-model te trainen) dat GPT-4 ongeveer 100 biljoen parameters zou kunnen hebben. Daardoor lijkt het voor velen dat GPT 4 vele malen krachtiger zal zijn dan zijn voorganger. Hieronder vindt je zijn quote, waar veel van de speculatie op gebaseerd is.

“100 trillion parameters is a low estimate for the number of neural connections in the human brain. If GPT-4 will have 100 trillion parameters, it will match the human brain in terms of parameters“

In werkelijkheid is de grootte van het model niet altijd direct gerelateerd aan de kwaliteit van het geproduceerde resultaat. Het aantal parameters hoeft niet noodzakelijkerwijs een correlatie te hebben met de prestaties die een AI-model heeft. Het is slechts één factor die de prestaties van het model beïnvloedt. Op dit moment hebben we veel grotere AI-modellen dan GPT-3, maar ze zijn niet het beste wat betreft prestaties.

Daarnaast is ook geval dat: hoe groter het model, hoe duurder het is om het te fine-tunen. GPT3 was al moeilijk en duur om te trainen, maar als je de grootte van het model met meer dan 500x verhoogt, zal het extreem duur zijn wat betreft de berekeningskracht en de hoeveelheid trainingsgegevens die nodig zijn voor het model. Het lijkt praktisch gezien onmogelijk om een model van die grootte op een efficiënte manier te trainen. Want hoewel veel mensen denken dat de AI vooral zichzelf traint, zijn er duizenden uren training nodig van specialisten om een AI-model kwalitatieve teksten te laten genereren.

Conclusie wat betrekt het aantal parameters

Onze conclusie: Het is zeer onwaarschijnlijk dat GPT-4 daadwerkelijk vele malen krachtiger zal zijn dan zijn voorganger, en ook een immense aantal parameters van 100 biljoen lijkt ons onwaarschijnlijk. Het lijkt ons meer waarschijnlijk dat OpenAI zich gaat richten op de kwaliteit van het model, in plaats van de grootte. Het aantal parameters zal best groter kunnen zijn (wij schatten dit op ergens tussen de 500 miljard en 1 biljoen ligt) maar 100 biljoen lijkt gewoonweg onmogelijk.

Update: Volgens Sam Altman, bestuursvoorzitter van OpenAI, zal GPT-4 niet veel groter zijn dan GPT-3. Dus we kunnen aannemen dat de geruchten rond de 100 biljoen parameters totaal ongegrond is, en het werkelijk aantal zelfs onder onze schatting van 500 miljard zal liggen.

Zal GPT-4 alleen tekst hebben of zal het multifunctioneel zijn?

AI-modellen kunnen alleen-tekst genereren maar ze kunnen ook multifunctioneel zijn. Alleen-tekst modellen accepteren tekst als input en produceren tekst als output. GPT-3 is een alleen-tekst model. Multifunctionele modellen kunnen tekst, audio, afbeeldingen en zelfs video’s produceren. Het geeft gebruikers de mogelijkheid om AI te gebruiken om audio of visuele content te genereren. Multifunctionaliteit is de toekomst van AI omdat de wereld waarin we leven dat ook is.

Goede multifunctionele modellen zijn aanzienlijk moeilijker te bouwen dan goede alleen-taalmodellen. Zoals ik het zie, probeert OpenAI de grenzen van alleen-taalmodellen te vinden, en zullen ze waarschijnlijk in deze richting blijven gaan. Dus GPT-4 zal dus waarschijnlijk een alleen-tekst model zijn.

Zal GPT-4 minder afhankelijk zijn van goede prompts?

Iedereen die ervaring heeft met het werken met GPT-3 weet hoe belangrijk het is om goede prompts te schrijven. Wanneer je moeite hebt om de juiste prompt te maken dan zal het eindresultaat niet altijd goed zijn. Een verwachting die veel mensen hebben over GPT-4 is dat dit model minder afhankelijk zal zijn van goede prompts. De hoop is dat GPT4 mensen beter begrijpt en ook sneller betere antwoorden kan geven.

Het doel dat OpenAI nastreeft is om taalmodellen de menselijke intenties perfect te laten begrijpen. Er is een hoge kans dat GPT-4 hier meer op georiënteerd is dan GPT-3. Voor de lancering van ChatGPT heeft het bedrijf geïnvesteerd in InstructGPT, een GPT-3 model dat is getraind op menselijk feedback om instructies te volgen en te begrijpen. InstructGPT is getraind op een grote dataset van instructie-teksten waaronder receptinstructies, how-to guides en andere soorten geschreven instructies. Het doel van InstructGPT is om natuurlijke tekst te genereren die helder, bondig en eenvoudig te volgen is. Dit kan het nieuwe model een stuk beter maken.

Voor zover dit artikel, wanneer we meer informatie hebben over GPT-4 dan zullen we de informatie updaten in dit artikel updaten.